多層パーセプトロン(MLP)は、機械学習や深層学習の基盤となるモデルです。この記事では、MLPの基本構造、活用例、課題、他の手法との違いを解説します。

MLP(多層パーセプトロン)とは何か?

MLP(多層パーセプトロン)は、複数の層を持つニューラルネットワークの一種で、複雑なデータ処理を行うモデルです。単純な線形モデルでは解決できない非線形な問題に対応できる点が特徴です。このセクションでは、MLPの基本構造や他のモデルとの違いを解説します。

単層パーセプトロンとどう違うのか?

単層パーセプトロン(SLP)は、入力層と出力層のみで構成されるシンプルなモデルであり、線形分離可能な問題にしか対応できません。一方、MLPは中間層(隠れ層)を複数持つため、非線形な問題、例えばXOR問題のような複雑なパターンを学習できます。この構造の違いにより、MLPは単層パーセプトロンよりも幅広いデータ処理に適しています。現代の機械学習では、非線形なデータパターンを扱う場面でMLPが広く活用されています。

ニューラルネットワークにおけるMLPの位置づけ

ニューラルネットワークは、脳の神経回路を模倣した計算モデルであり、人工知能の一分野です。MLPは、ニューラルネットワークの中でも基本的なモデルとして位置づけられ、ディープラーニングの基盤となっています。画像、音声、テキストなど多様なデータに対応可能な汎用性を持ち、CNNやRNNなどの特殊なネットワークの原型とも言えます。このため、MLPはニューラルネットワークの入門モデルとして初心者にも理解しやすく、実際の応用にも柔軟に対応します。

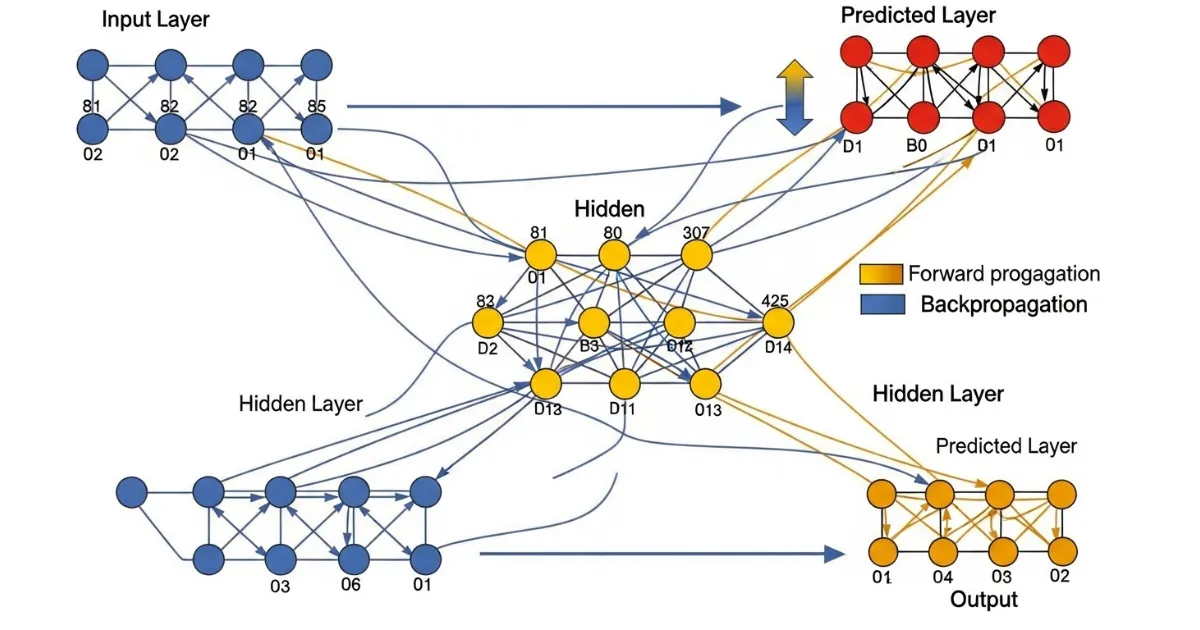

MLPの基本構造:入力層・中間層・出力層

MLPは、入力層、中間層(隠れ層)、出力層の3つの層で構成されます。入力層はデータをモデルに受け渡し、中間層はデータの特徴を抽出・変換し、出力層は最終的な結果を出力します。各層はノード(ニューロン)で構成され、ノード間は重みで接続されています。活性化関数(ReLUやシグモイドなど)を用いることで非線形性を導入し、複雑なパターンの学習を可能にします。この構造が、MLPの多様なデータ処理能力を支えています。

MLPでできること・活用例

MLP(多層パーセプトロン)は、単純な分類から複雑な予測まで幅広いタスクに対応可能です。このセクションでは、具体的な活用例や対応可能なデータタイプを紹介します。

非線形な分類・回帰問題への対応

MLPは、非線形な関係性を持つデータに対して高い性能を発揮します。例えば、スパムメールの判別や病気の診断といった分類タスク、住宅価格や売上の予測といった回帰タスクに適しています。線形モデルでは扱えない複雑なパターンを学習できるため、医療分野では患者の検査データから病気の有無を分類するモデルとして活用されるなど、非線形な問題解決に欠かせないツールとなっています。

画像・音声・テキストなど多様なデータ処理

MLPは、画像、音声、テキストなどさまざまなデータ形式に対応可能です。画像処理ではピクセルデータを入力として物体認識を行い、音声処理では音声波形から感情分析を実施します。自然言語処理(NLP)では、文章をベクトル化して感情分類やトピック分類を行う場面で使用されます。このように、MLPの柔軟性は多様なデータ処理ニーズに応える強みとなっています。

未来のデータの予測や傾向分析

MLPは、時系列データや傾向分析にも活用されます。過去の売上データから未来の売上を予測したり、気象データから気温や降水量の傾向を分析したりするタスクに適しています。金融市場では、株価や為替レートの変動予測にも使用されます。これらの予測は、ビジネスや研究における意思決定を支援する重要な役割を果たします。

MLPと機械学習・深層学習の関係

MLP(多層パーセプトロン)は、機械学習や深層学習の基盤となるモデルです。このセクションでは、MLPがこれらの分野にどのように位置づけられるかを解説します。

教師あり学習におけるMLPの役割

教師あり学習は、ラベル付きデータを使ってモデルを訓練する方法です。MLPは、データのクラスを予測する分類タスクや連続値を予測する回帰タスクにおいて重要な役割を果たします。例えば、画像データに「猫」「犬」などのラベルを付けて分類するタスクで高い精度を発揮します。多様なデータ形式に対応可能な柔軟性を持つため、教師あり学習の基盤モデルとして広く採用されています。

ディープラーニングの基礎モデルとしてのMLP

ディープラーニングは、複数の層を持つニューラルネットワークを用いた手法です。MLPは、隠れ層を増やすことで複雑な学習を可能にし、データ量や計算リソースに応じて拡張できるスケーラビリティを備えています。CNNやRNNなどのモデルは、MLPの構造を発展させたものであり、ディープラーニングの入門モデルとして初心者にも理解しやすい特徴があります。この基本構造が、ディープラーニングの進化を支えています。

関連記事:Zero Shotとは?仕組みや応用例、他手法との違いまでわかりやすく解説

MLPと他のニューラルネットワークとの違い

MLP(多層パーセプトロン)は、他のニューラルネットワークと異なる特性を持ちます。このセクションでは、代表的なモデルとの比較を行います。

比較表:MLPと他のニューラルネットワーク

| モデル | 主な用途 | 構造の特徴 | メリット | デメリット |

|---|---|---|---|---|

| MLP | 分類・回帰 | 全結合層 | 汎用性が高い | 計算コストが高い |

| CNN | 画像処理 | 畳み込み層 | 局所パターンに強い | 時系列データに弱い |

| RNN | 時系列処理 | 再帰構造 | 順序情報を扱える | 勾配消失問題 |

| LSTM | 長期的依存関係 | メモリセル | 長期記憶が可能 | 計算が複雑 |

CNN(畳み込みニューラルネットワーク)との違い

CNNは、画像や空間データに特化したモデルです。畳み込み層とプーリング層を持ち、局所的な特徴を効率的に抽出します。画像認識や物体検出に最適ですが、MLPは全結合層で全ての入力を均等に扱うため、より汎用的なデータ処理に適しています。構造化されたデータに対してはCNNが優れますが、MLPは柔軟性で勝ります。

RNN(再帰型ニューラルネットワーク)との違い

RNNは、時系列データや順序データに特化しており、前の情報を保持する再帰構造を持っています。音声認識や自然言語処理に適していますが、MLPは順序情報を考慮しないため、静的なデータ処理に適しています。RNNは時系列の依存関係を学習する点で優れますが、MLPは単純な構造で幅広いタスクに対応可能です。

LSTMやGANとの比較

LSTMはRNNの改良版で、長期依存関係を学習でき、GANはデータの生成に特化した生成モデルです。MLPは基本的な分類・回帰に適しており、LSTMやGANは特定のタスクに特化しています。これらのモデルは、MLPの基本構造を基盤に発展したもので、MLPの汎用性が特化した応用を生み出しています。

MLPの課題と限界

MLP(多層パーセプトロン)は強力なモデルですが、いくつかの課題があります。このセクションでは、代表的な問題とその対策を解説します。

勾配消失問題とその対策

勾配消失問題は、深層ネットワークで学習が進まない問題です。深い層で勾配が小さくなり、学習が停滞します。この問題は、ReLU活性化関数やバッチ正規化を用いることで軽減できます。TensorFlowやPyTorchでの実装も容易であり、適切な手法を取り入れることで、MLPの深層化が可能になります。

パラメータの多さによる過学習リスク

MLPはパラメータ数が多いため、訓練データに過剰適合する過学習のリスクがあります。ドロップアウトや正則化(L1/L2)を導入することで、モデルの複雑さを制御し、過学習を防ぎます。ハイパーパラメータの調整も重要であり、適切な設定でモデルの汎化性能を高められます。

ブラックボックス性と説明性の問題

MLPは、内部の動作が理解しにくい「ブラックボックス」モデルです。複雑な層構造により、結果の透明性が欠ける場合があります。SHAPやLIMEなどの説明性向上ツールを用いることで、医療や金融など透明性が求められる分野での活用が可能です。説明性の向上は、MLPの信頼性を高める鍵となります。

MLPの実装とチュートリアル(初学者向け)

MLP(多層パーセプトロン)の実装は、初心者でも取り組みやすいタスクです。このセクションでは、具体的な実装例を紹介します。

XOR問題を解くMLPの実装

XOR問題は、MLPの非線形学習能力を示す代表的な例です。入力データ(0,0)、(0,1)、(1,0)、(1,1)と出力(0,1,1,0)を用いて、2つの入力ノード、隠れ層、出力ノードで構成されるモデルを構築します。PythonとTensorFlowを使用した実装例を以下に示します。

python

import tensorflow as tf

from tensorflow.keras import layers, models

import numpy as np

# データ準備

X = np.array([[0,0], [0,1], [1,0], [1,1]])

y = np.array([[0], [1], [1], [0]])

# モデル構築

model = models.Sequential([

layers.Dense(4, activation='relu', input_shape=(2,)),

layers.Dense(1, activation='sigmoid')

])

# コンパイルと学習

model.compile(optimizer='adam', loss='binary_crossentropy', metrics=['accuracy'])

model.fit(X, y, epochs=1000, verbose=0)

# 予測

print(model.predict(X))このコードは、XOR問題を解くシンプルなMLPモデルを示しており、初心者にも理解しやすい内容です。

Pythonやライブラリ(TensorFlow/PyTorch)での実装

TensorFlowやPyTorchを用いると、MLPの実装が容易になります。TensorFlowは高レベルAPI(Keras)で簡単にモデルを構築でき、PyTorchは柔軟なモデル設計が可能です。実装手順は、データ準備、モデル構築、学習、評価の流れで進められます。これらのライブラリは初心者向けのチュートリアルも豊富で、コミュニティのサポートも充実しています。

MLPをベースとした関連モデル

MLP(多層パーセプトロン)は、他の先進的なモデルにも影響を与えています。このセクションでは、MLPを基盤としたモデルを紹介します。

MLP-Mixerとは?

MLP-Mixerは、画像処理に特化した新しいモデルで、畳み込みを排除し、MLPのみで画像を処理します。軽量で高速な学習が可能な点が特徴で、画像分類や物体認識に適しています。CNNに代わる新しいアプローチとして、研究や実務で注目を集めています。

Transformerとの接点

Transformerは、自然言語処理や画像処理で広く使われるモデルです。MLPをフィードフォワード層として内部に組み込んでおり、アテンション機構と組み合わせることで高い性能を発揮します。BERTやVision Transformerなどのモデルは、MLPの基本構造を活用した応用例です。この接点が、MLPの汎用性を示しています。

MLPの応用分野:音声処理・自然言語処理

MLPは、音声認識、感情分析、テキスト分類、異常検知、医療診断など多岐にわたる分野で応用されています。音声処理では音声波形を、自然言語処理では文章をベクトル化して処理し、高い精度を実現します。これらの分野での柔軟な活用が、MLPの強みとなっています。

MLPの今後と研究動向

MLP(多層パーセプトロン)は、研究や産業界で進化を続けています。このセクションでは、最新の動向を紹介します。

最新論文・学術動向の簡単な紹介

最近の研究では、MLPの効率化や新たな応用が注目されています。軽量なMLPモデルの開発や、医療、自動運転などでの活用が進められています。例えば、「MLP-Mixer: An All-MLP Architecture for Vision」などの論文は、MLPの可能性を広げる研究として知られています。

産業界での活用事例の変化

産業界では、医療の診断支援システム、金融のリスク評価や不正検知、製造業の品質管理や予測システムなど、MLPの活用が進んでいます。特に、自然言語処理でのデータ解析や、異常検知の精度向上に貢献しています。これらの事例は、MLPの実用性を高める変化を示しています。

まとめ:MLPの基本と応用を押さえよう

MLPは、機械学習や深層学習の基礎モデルとして、分類、回帰、予測など多様なタスクに対応可能です。単層パーセプトロンや他のニューラルネットワークとの違いを理解し、課題を把握することで、効果的に活用できます。Pythonでの実装も容易で初心者にも取り組みやすく、研究や産業界での進化も期待される分野です。MLPを学び、AIの第一歩を踏み出してください!

コメント